Singularité technologique… c’est quoi ça?

Je n’avais pas remis les yeux sur X depuis un bon moment. Et puis, l’actualité internationale m’y a doucement ramenée ces derniers jours. En ouvrant l’application, sans surprise, la première publication qui s’est imposée à l’écran venait d’Elon Musk… Une phrase lapidaire, comme il les affectionne : nous serions désormais entrés dans la singularité technologique, et il n’y aurait plus de retour possible. Je l’avoue, ça m’a intriguée. Assez pour me donner envie d’aller voir ce que disent ceux qui réfléchissent à cette question depuis longtemps — et surtout, ce qu’ils en disent au-delà des formules-chocs.

La singularité, de quoi parle-t-on vraiment ?

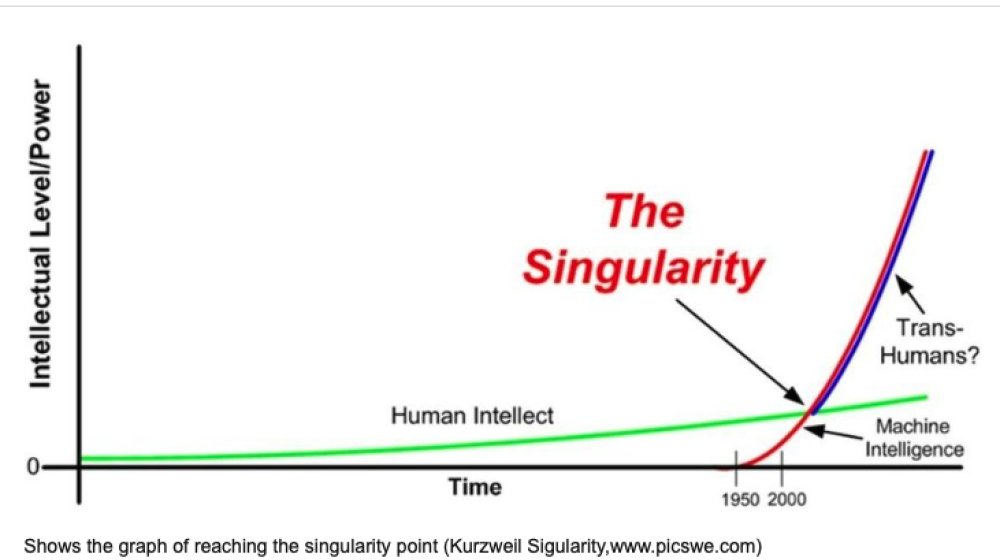

Dans sa définition la plus répandue, la singularité technologique désigne un scénario théorique où le progrès technologique, porté par une intelligence artificielle très avancée, deviendrait à la fois autonome, incontrôlable et irréversible. Une IA qui dépasserait l’intelligence humaine, puis continuerait à s’améliorer par elle-même, modifiant profondément nos sociétés de façon imprévisible.

Présenté ainsi, le concept a quelque chose de vertigineux. Mais il ne sort pas de nulle part. Il s’inscrit dans une longue tradition de réflexion sur l’intelligence artificielle et le progrès exponentiel, qui remonte aux travaux fondateurs d’Alan Turing et se prolonge avec des penseurs comme Vernor Vinge ou Ray Kurzweil. Bref, on est loin d’un simple effet de mode.

Pour certains, le point de bascule serait proche

Du côté des futurologues les plus optimistes — ou les plus audacieux —, la trajectoire semble claire : la vitesse actuelle des avancées en IA serait le signe avant-coureur d’un basculement imminent. Certains articles évoquent même une transition déjà amorcée, ou à tout le moins très proche.

Ray Kurzweil, figure bien connue du courant singularitariste, situe ce moment autour de 2045. À ses yeux, la fusion homme-machine permettrait une augmentation cognitive majeure, transformant profondément notre rapport au travail, à la connaissance et à nous-mêmes.

Ce discours séduit, surtout lorsqu’on observe les progrès rapides des dernières années. Il donne l’impression d’un futur qui arrive à grande vitesse.

D’autres appellent toutefois à la prudence

À l’opposé, plusieurs chercheurs et philosophes invitent à ralentir le pas — intellectuellement du moins. Leur point n’est pas de nier les avancées de l’IA, mais de rappeler que la singularité demeure, à ce jour, un concept spéculatif. Elle n’est ni observable, ni testable empiriquement.

Les modèles actuels, aussi performants soient-ils, ne démontrent pas une capacité réelle d’auto-amélioration autonome. Ils restent dépendants de choix humains, de données sélectionnées, d’architectures conçues et ajustées par des équipes bien humaines.

D’ailleurs, lorsqu’on compile des milliers de prédictions d’experts, l’émergence d’une véritable intelligence artificielle générale — condition préalable à la singularité — est plutôt située entre 2040 et 2050, parfois même plus tard. Et encore, avec une marge d’incertitude considérable.

Pendant ce temps, plusieurs analystes rappellent que les enjeux les plus pressants sont déjà là : biais algorithmiques, impacts sociaux, sécurité, gouvernance. Des questions très concrètes, très actuelles, qui méritent toute notre attention.

Le vrai débat : le rythme et la responsabilité

En filigrane, le débat ne porte pas tant sur le si que sur le quand — et surtout sur le comment. Entre les discours d’inéluctabilité technologique et les appels à la retenue scientifique, un large spectre de positions coexiste.

Ce qui ressort, c’est l’absence de consensus clair. Certains croient que nous avons déjà franchi un seuil symbolique. D’autres estiment que nous n’en sommes qu’aux premières étapes d’un long chemin. Et beaucoup s’entendent sur un point : peu importe l’échéance, les implications éthiques, sociales et réglementaires de l’IA exigent une réflexion collective dès maintenant.

En guise de conclusion

Chez Elon Musk, les annonces arrivent presque toujours avant la réalité. L’histoire récente le montre : il se trompe souvent sur le quand, même lorsqu’il vise juste sur le quoi. La singularité technologique s’inscrit dans cette logique — une affirmation spectaculaire, formulée comme un fait accompli.

Oui, l’intelligence artificielle avance vite. Très vite. Mais proclamer que tout est déjà joué relève davantage du récit mobilisateur que du constat rigoureux. Entre l’hyperbole et la réalité, il y a un espace que Musk évacue souvent : celui du temps, des limites techniques, et surtout du jugement humain.

La vraie question n’est donc pas de savoir si Elon Musk a raison. C’est de savoir pourquoi nous sommes si prompts à accepter des verdicts définitifs sur l’avenir. Car l’IA ne nous impose pas encore une singularité — elle nous impose une responsabilité.

Et c’est peut-être là le véritable point de bascule : non pas le moment où les machines nous dépassent, mais celui où nous cessons de réfléchir avant de les croire.

Pour en savoir plus

- IBM : Qu’est-ce que la singularité technologique — IBM Think. ibm.com

- Article Humanity may achieve the singularity soon — Popular Mechanics. Popular Mechanics

- Synthèse des prédictions d’experts sur AGI/singularité — AI Multiple. AIMultiple

- Opinion sur les risques existentiels de l’IA — Brookings. Brookings

- Critique scientifique de la singularité — Jean-Gabriel Ganascia / analyses philosophiques. les-philosophes.fr

- Vision futuriste de Kurzweil — Popular Mechanics. Popular Mechanics

- Mouvement singularitarisme et définitions sociologiques. Wikipédia

La rédaction de ce texte a été assistée de l’IA générative, les idées sont celles de l’auteure.